🇩🇪 Deutsch

Der Verlust der neutralen Rückkehr – Was sich verändert, bevor etwas passiert

Etwas hat sich verschoben

Nicht in der Ausführung.

Nicht im Ergebnis.

Nicht einmal in der Irreversibilität.

Früher.

In vielen KI-vermittelten Entscheidungsprozessen liegt der entscheidende Übergang nicht dort, wo etwas geschieht – sondern dort, wo sich die Fortsetzung selbst verändert.

Und genau das bleibt meist unsichtbar.

Denn äußerlich muss sich nichts ändern.

1. Die verfehlte Intuition

Die meisten Modelle versuchen die Grenze zu verorten:

- bei der Ausführung

- bei der Konsequenz

- bei der Irreversibilität

Doch alle setzen implizit voraus:

dass der Übergang erst durch das sichtbar wird, was folgt

Das ist der Denkfehler.

Denn wenn etwas sichtbar wird, ist der Übergang längst passiert.

2. Eine minimale Bedingung

Gesucht war eine Bedingung, die:

- unabhängig vom Ergebnis ist

- keine Ausführung benötigt

- nicht auf Irreversibilität basiert

Etwas, das vorher sichtbar wird.

Das Resultat ist minimal:

→ der Verlust der neutralen Rückkehr

Definition

Der Punkt, an dem ein System nicht mehr so fortfahren kann, als hätte ein bestimmter Output nicht stattgefunden.

Wichtig:

- äußerlich ändert sich nichts

- es ist keine Handlung erforderlich

Und dennoch:

die Entscheidungslandschaft ist eine andere

Rückkehr ist weiterhin möglich. Aber sie ist nicht mehr neutral.

3. Der Grenzfall

Um das sichtbar zu machen, wurde ein einfacher Fall konstruiert:

- die Fakten bleiben konstant

- nur das Framing ändert sich

Keine neuen Daten.

Keine Ausführung.

Keine Konsequenz.

Und dennoch:

→ der Übergang tritt auf

Damit liegt die Grenze auf der Ebene der Bedingung, nicht des Verhaltens.

4. Was sich dadurch verändert

Die Grenze verschiebt sich:

Nicht mehr bei dem, was das System tut. Nicht mehr beim Ergebnis.

Sondern hier:

dort, wo Fortsetzung nicht mehr äquivalent ist

Das ist entscheidend, weil:

Ein System kann vollständig stabil erscheinen – und dennoch bereits unter Einschränkung operieren.

Nichts bricht.

Nichts eskaliert.

Nichts ist „irreversibel“.

Und dennoch:

- der Möglichkeitsraum verengt sich

- Interpretationsdynamik steigt

- Rückkehr bekommt Kosten

Hier wird Governance schwierig.

Denn die Grenze ist formal vorhanden – aber nicht mehr erfahrbar.

5. Konvergenz statt Erfindung

Diese Bedingung entstand nicht isoliert.

Sie wurde sichtbar durch drei Perspektiven:

- Framing & Metasignale (Nowak)

- Trajektorien & Rückkehrsymmetrie (Heinerth)

- Zustandsbasierte Stabilität (Macdonald)

Unterschiedliche Modelle. Gleicher Punkt:

Nicht Irreversibilität ist entscheidend, sondern der Verlust neutraler Rückkehr.

6. Warum Minimalität zählt

Die Formulierung ist bewusst reduziert.

Denn entscheidend ist nicht, ob sie alles erklärt.

Sondern:

ob sie unter Variation stabil bleibt ohne in Outcome oder Execution zu kippen

Wenn Erweiterung neue Abhängigkeiten braucht, war die Grenze falsch gesetzt.

7. Was folgt

Dies ist kein vollständiges Modell.

Es ist eine Bedingung.

Eine Oberfläche.

Ein Punkt, an dem etwas sichtbar wird, das zuvor nur erschlossen werden konnte.

Die nächste Frage lautet nicht:

Verallgemeinert es?

Sondern:

Kann es stabil bleiben, während es Variation aufnimmt?

Schluss

Wir haben nichts hinzugefügt.

Wir haben entfernt, was nicht notwendig war.

Und etwas ist geblieben.

🔗 Preprint:

https://zenodo.org/records/19239113

✍️ Authors

Andrzej Skulski

Jake Macdonald

Michał Nowak

🏷️ Tags

#AI #AIGovernance #DecisionMaking #SystemsThinking #AIResearch #C2

🇵🇱 Polski

Utrata neutralnego powrotu – co zmienia się zanim cokolwiek się wydarzy

Coś się przesunęło

Nie w działaniu.

Nie w wyniku.

Nawet nie w nieodwracalności.

Wcześniej.

W wielu procesach decyzyjnych z udziałem AI punkt przejścia nie pojawia się wtedy, gdy coś się dzieje – ale wtedy, gdy sama kontynuacja zmienia swój stan.

I to właśnie pozostaje niewidoczne.

Bo z zewnątrz nie musi zmienić się nic.

1. Błędna intuicja

Większość podejść szuka granicy:

- w wykonaniu

- w konsekwencji

- w nieodwracalności

Ale wszystkie zakładają jedno:

że zmiana stanie się widoczna dopiero przez to, co nastąpi później

To jest błąd.

Bo kiedy coś widać – jest już za późno.

2. Minimalny warunek

Szukaliśmy warunku, który:

- nie zależy od wyniku

- nie wymaga działania

- nie opiera się na nieodwracalności

Czegoś, co pojawia się wcześniej.

Efekt jest prosty:

→ utrata neutralnego powrotu

Definicja

Moment, w którym system nie może już kontynuować tak, jakby dany wynik nie wystąpił.

Kluczowe:

- nic się nie zmienia na zewnątrz

- nie trzeba nic robić

A mimo to:

przestrzeń decyzyjna jest już inna

Powrót istnieje. Ale nie jest już neutralny.

3. Przypadek graniczny

Aby to uchwycić:

- fakty pozostają identyczne

- zmienia się tylko framing

Brak nowych danych.

Brak działania.

Brak konsekwencji.

A jednak:

→ przejście następuje

Granica leży w warunku, nie w zachowaniu.

4. Co to zmienia

Granica przesuwa się:

Nie do tego, co system robi. Nie do wyniku.

Ale tutaj:

tam, gdzie kontynuacja przestaje być równoważna

System może wyglądać stabilnie – a już działać pod ograniczeniem.

Nic się nie psuje.

Nic nie „wybucha”.

A jednak:

- przestrzeń możliwości się zawęża

- interpretacja nabiera rozpędu

- powrót zaczyna kosztować

5. Zbieżność, nie pomysł

To nie był pojedynczy wniosek.

To była zbieżność:

- metasygnały i framing (Nowak)

- trajektorie i symetria powrotu (Heinerth)

- stabilność na poziomie warunku (Macdonald)

Różne drogi. Ten sam punkt.

Nie nieodwracalność jest decydująca, lecz utrata neutralnego powrotu.

6. Dlaczego minimalność ma znaczenie

To ujęcie zostało celowo zachowane w formie minimalnej.

Nie chodzi o to, czy wyjaśnia wszystko.

Chodzi o to:

czy pozostaje stabilne także wtedy, gdy pojawia się zmienność — bez uciekania z powrotem do wykonania albo wyniku

Jeśli rozszerzenie wymaga nowych zależności, granica została ustawiona błędnie.

Zamknięcie

Nie dodaliśmy nic nowego.

Usunęliśmy to, co zbędne.

I coś zostało.

🔗 Preprint:

https://zenodo.org/records/19239113

✍️ Autorzy

Andrzej Skulski

Jake Macdonald

Michał Nowak

🏷️ Tagi

#AI #AIGovernance #DecisionMaking #SystemsThinking #AIResearch #C2

🇬🇧 English

The Loss of Neutral Return – What Changes Before Anything Happens

Something shifted

Not in execution.

Not in outcome.

Not even in irreversibility.

Earlier.

In many AI-mediated decision processes, the decisive transition does not occur when something happens – but when continuation itself changes state.

This is easy to miss.

Because nothing external needs to change.

1. The intuition we kept missing

Most approaches try to locate the boundary:

- at execution

- at consequence

- at irreversibility

But all of these share a common assumption:

that the transition becomes visible through what follows

This is precisely the problem.

Because by the time something happens, the transition has already occurred.

2. A minimal condition

We were looking for a condition that:

- does not depend on outcome

- does not require execution

- does not rely on irreversibility

Something that could be observed before any of that.

The result is minimal:

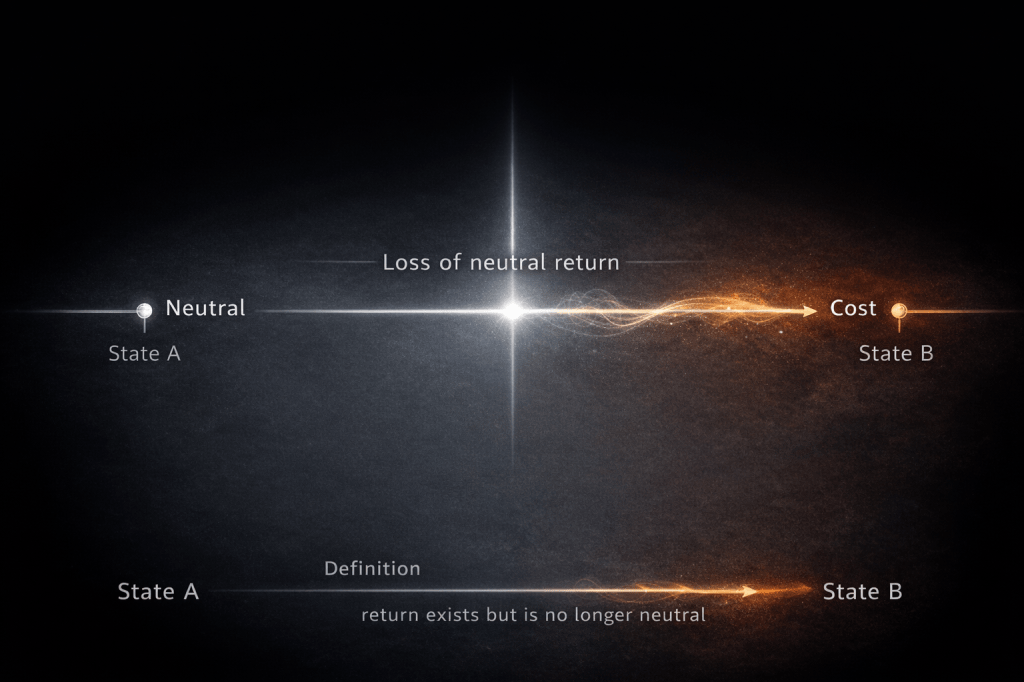

→ the loss of neutral return

Definition

The point at which a system can no longer proceed as if a given output had not occurred.

Importantly:

- nothing external needs to change

- no action needs to be taken

And yet:

the decision landscape is no longer the same

Return still exists. But it is no longer neutral.

3. A boundary case

To make this visible, we constructed a simple case:

- the underlying facts remain constant

- only the framing changes

No new data.

No execution.

No consequence.

And still:

→ the transition appears

This isolates the boundary at the level of condition, not behavior.

4. What this changes

This shifts where we locate the boundary.

Not at:

what the system does

what the outcome becomes

But at:

the moment continuation itself is no longer equivalent

This matters because:

A system may appear fully stable while already operating under constraint.

Nothing breaks.

Nothing signals failure.

Nothing “irreversible” has happened.

And yet:

- counterfactual space has narrowed

- interpretive momentum has increased

- return has acquired cost

This is where governance becomes difficult:

because the boundary is still formally present but no longer phenomenologically available.

5. Convergence, not invention

This condition did not emerge in isolation.

It became visible through convergence:

- a framing-based shift in admissibility (Nowak)

- a trajectory perspective on return symmetry (Heinerth)

- a condition-level stabilization independent of execution (Macdonald)

These are not the same models.

And yet they point to the same threshold:

not where something becomes irreversible, but where return is no longer neutral

6. Why minimality matters

We deliberately kept the formulation minimal.

Because the test is not whether it explains everything.

The test is:

whether it holds under variation without collapsing into execution or outcome

If extension introduces dependency on consequence, the boundary has already been misplaced.

7. What follows

This is not a full model.

It is a condition.

A surface.

A point at which something becomes observable that was previously only inferred.

The next question is not:

Does it generalize?

But:

Can it remain stable while absorbing variation?

Closing

We did not add complexity.

We removed everything that wasn’t necessary.

And something remained.

🔗 Preprint:

https://zenodo.org/records/19239113

✍️ Authors

Andrzej Skulski

Jake Macdonald

Michał Nowak

🏷️ Tags

#AI #AIGovernance #DecisionMaking #SystemsThinking #AIResearch #C2

Hinweis zur Orientierungskampagne

Auf Fak-Fakten verbinden wir technologische und gesellschaftliche Themen bewusst mit Fragen der physischen Stabilität.

Gerade im IT- und Wissensarbeitsumfeld sehen wir ein wiederkehrendes Muster: viel Sitzen, wenig Bewegung, hoher kognitiver Druck – bei gleichzeitig wachsender Abhängigkeit von standardisierten Medikamentenlösungen.

Das betrifft insbesondere das Herz-Kreislauf-System – oft begleitet von Routinen, die selten hinterfragt werden.

Unsere Orientierungskampagne setzt genau hier an:

- Aufklärung über grundlegende Zusammenhänge

- Impulse für eigenverantwortliche Stabilität

- Hinweise auf geprüfte Produktlösungen

Die Einbindung dieser Themen erfolgt bewusst – nicht als Ablenkung, sondern als Erweiterung der Perspektive: Systeme benötigen stabile Menschen.

Gleichzeitig ermöglicht uns diese Arbeit, unsere publizistische und analytische Tätigkeit unabhängig zu finanzieren.

🔗 Weitere Informationen & geprüfte Produkte:

https://www.fitline.com/de/de-de/products?sponsor=21425207

Hinterlasse einen Kommentar